المحتال يُسجّل الصوت ثم يُزوّره بالذكاء الاصطناعي ويستخدمه لإيقاع الضحية

آخر الحيل الجديدة... «النصب الصوتي»

- قصي الشطي: وسائل الاحتيال تتطور مع التكنولوجيا

- صالح الشمري: التأكد دائماً من المكالمات الواردة

- خالد الصلال: نسخ الصوت من مقاطع لا تتجاوز 3 ثوانٍ

حذر خبراء تكنولوجيا وأمن المعلومات من حيلة جديدة بدأت في الانتشار تعتمد على استخدام نبرة الصوت من خلال برامج الذكاء الاصطناعي الصوتية، لافتين إلى أن «الطريقة الجديدة للاحتيال قائمة على قيام الشخص المحتال بالاتصال من أجل هدف واحد وهو تسجيل نبرة صوت المتصل به، ويقوم المحتال بعدها بإنهاء المكاملة، ليقوم بعدها بالاتصال بأحد الأصدقاء أو الأقارب طالباً منهم تحويل أموال باستخدام الصوت المُعدّل بالذكاء الاصطناعي».

وفي هذا السياق، قال خبير الأمن السيبراني المهندس صالح الشمري لـ«الراي»، «ثمة علاقة طردية بين التطور التكنولوجي والهجمات السيبرانية، فكلما زاد تطور التكنولوجيا زادت الهجمات السيبرانية»، موضحاً أن «عمليات الاحتيال والنصب الإلكتروني هدفها الابتزاز المادي في المقام الأول».

وكشف أن «أحدث ما توصل له الهاكرز حول العالم هو استخدام الذكاء الاصطناعي في تقليد الأصوات حيث يقوم المحتال بأخذ عيّنة من صوت الضحية سواء مُسجلة أو عن طريق الاتصال بعد استدراج الضحية في الحديث لمدة مُناسبة لأخذ جميع مخارج الأحرف ونبرات الصوت الخاصة به، واستخدامها بطريقة توقع أقاربه أو معارفه في الفخ».

وشدد الشمري على «ضرورة الحذر من هذه الأساليب والتأكد دائماً من المكالمات الواردة لمعرفة ما إذا كان الشخص المتصل فعلاً هو الشخصية الحقيقية التي نعرفها أم هو شخصية تقنية مستوحاه من عالم الذكاء الاصطناعي».

إلى ذلك، قال خبير تكنولوجيا المعلومات قصي الشطي لـ «الراي»، إن «وسائل الاحتيال الإلكتروني تتطور مع تطور الوسائل التقنية والتكنولوجية وما تتيحه من إمكانيات جديدة»، لافتاً إلى أن «هناك من يستخدم هذه التكنولوجيا من أجل أهداف ضارة ومسيئة مثل الاحتيال الإلكتروني لسرقة الأموال والحسابات وتحقيق عائد مادي غير مشروع».

وأضاف أنه «في السابق كانت ترد رسائل قصيرة من أرقام هواتف متنقلة محتواها أن البطاقة البنكية تم إيقافها ويجب الاتصال لأخذ بيانات البطاقة من الفرد، وبعدها تغير النمط ليصبح اتصالاً مع تسجيل صوتي يوهم المتصل أنه وارد من مؤسسة مالية، ثم وصلنا لتقنيات نسخ الأصوات».

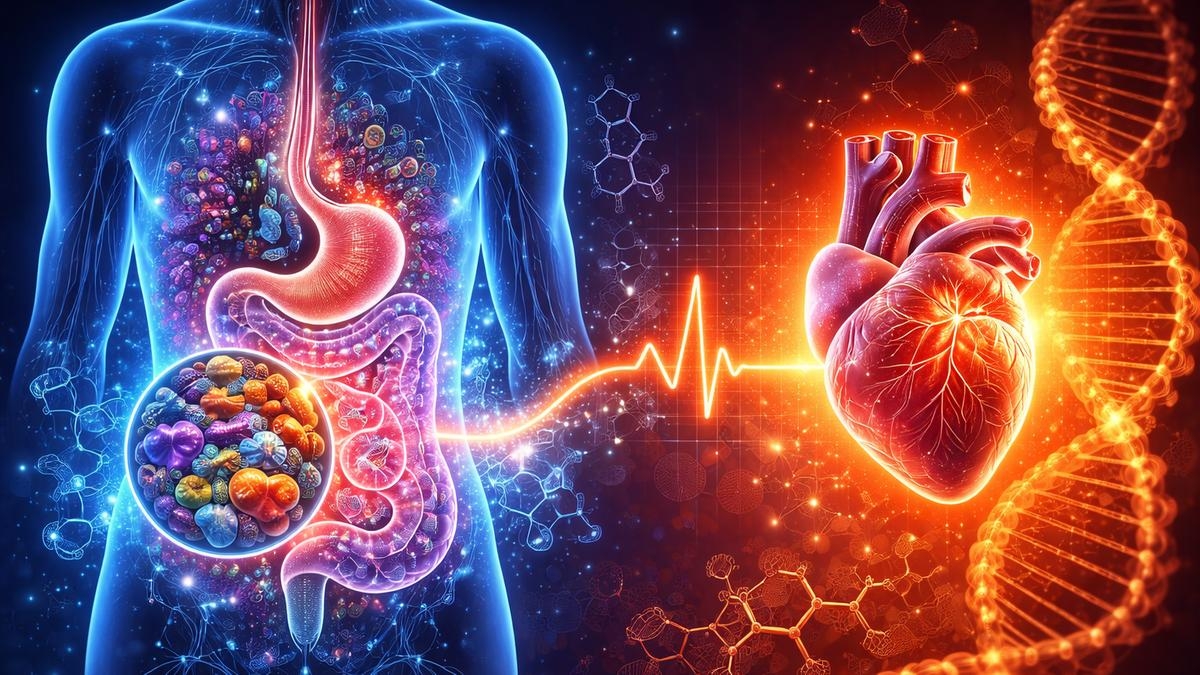

بدوره، أوضح الخبير الأمني والإستراتيجي خالد الصلال لـ «الراي»، أن«خطورة أنظمة الذكاء الاصطناعي، تكمن في قدرتها على القيام بتزييف عميق للأصوات، باستخدام برامج تقنية (Deep Fake) التي أصبحت متوافرة، ويمكنها بسهولة تقليد صوت شخص ما بدرجة من الدقة يمكن أن تخدع كل من البشر وكذلك الأجهزة الذكية»، ضارباً المثل بـ«برنامج (SV2TTS) الذي يحتاج فقط إلى مدة خمس ثوان لإنتاج مقطع صوتي يتميّز بتقليد مقبول لأي شخص».

ولفت الصلال إلى أن «شركة مايكروسوفت قامت بتطوير برنامج آخر يطلق عليه تطبيق (Vall E)، وهو أداة دقيقة لأي شخص يتطلع إلى إنشاء صوت يبدو أكثر طبيعة من أي برامج أخرى، وذلك من خلال مدة تسجيل صوتية لا تتجاوز ثلاث ثوانٍ فقط».